Bu hafta sonu, uzun süredir aklımda olan ama hiç yazmak istemediğim bir konu hakkında yazacağım. Daha önce yazmak istemememin nedeni, eşek ve karpuz kabuğu ilişkisi nedeniyleydi. Bu tehlikeli teknolojiden haberi olmayan kötü niyetli kişilerin, bu teknolojiyi benim yazımdan öğrenip kullanma olasılığını kafamda tartıyordum.

Sonra bu hassasiyetimin çok safça olduğuna ve kendi sorumluluğuma fazla önem atfettiğime ikna oldum. Çünkü bilmesinden korkulan herkes, bir şekilde bu teknolojiyi biliyordu.

ABD’de yaşanan benzer bir skandal, benim yazıyı yazma kararı almamda tetikleyici oldu. Yapay zekânın muazzam faydalarıyla birlikte, riskleri ve tehlikelerinden teorik olarak bahsedip duruyoruz ama bu yazıda anlatacağım gibi elle tutulur örnekler, konuyu daha iyi anlamamızı sağlayabilir.

ABD’de liseler alarma geçti

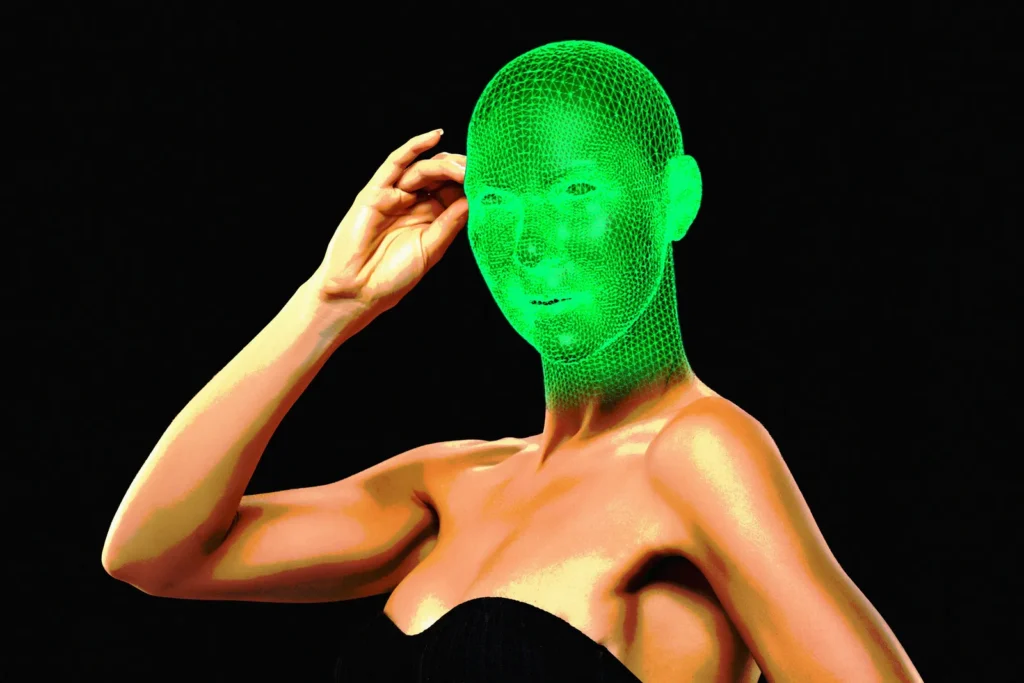

NBC’nin haberine göre, 2023-2024 Eğitim-Öğretim Yılı’nın başlamasından bu yana deepfake olarak bilinen teknoloji yardımıyla üretilen sahte pornografik fotoğraflar, New Jersey ve Washington eyaletindeki liseler başta, dünya çapında daha büyük hızla yayılıyor.

Basına yansıyan en yakın skandal, New Jersey eyaletinde bulunan Westfield Lisesi’nde yaşanmış. Bu lisede 30’dan fazla kız öğrencinin, yapay zekâ yardımıyla oluşturulan sahte pornografik fotoğraflarıyla başlayan bir süreçten söz ediliyor.

ABD’de tek örnek bu değil, ayrıca İspanya’da da benzer bir olay gündemde.

Bu görüntüleri oluşturmak için mağdurların poz vermesi hatta üretenlerle bir şekilde tanışması bile gerekmiyor.

Zaten sosyal medyada bolca bulunabilen giyinik fotoğrafların sisteme yüklenmesi yeterli.

Yani bir zamanlar çok konuşulan ‘çıplak gösteren gözlük fantezisi’ teknoloji yardımıyla gerçek olmuş durumda.

Hatta yüklenen fotoğraflarla pornografik video üretilebildiği de biliniyor. Bunun için bir teknik bilgiye hatta çoğunlukla maddi imkana sahip olunmasına gerek yok.

Uygulama marketlerinden veya web sayfalarından, ücretsiz deneme sürümleri ve cüzi miktar ödemeler karşılığında bu yapay zekâ araçlarına ulaşmak mümkün.

“Bu kadar kolay olmamalı” şaşkınlığıyla yaptığım küçük bir araştırma ve test süreci de maalesef bu sistemlerin gayet ulaşılabilir ve kullanılabilir olduğunu gösterdi.

Teknoloji karşısında çaresizlik

Westfield Lisesi’nde henüz ikinci sınıf öğrencisi olan ve 15 yaşına yeni giren Francesca Mani, kendisinin ve arkadaşlarının mağduru olduğu bu sürece şahit olunca, bir hareket başlattı ve konu ABD kamuoyunda biraz daha konuşulur oldu.

Francesca’nın, akranları arasında bu konuda farkındalık oluşturmak için hazırladığı bir web sitesi bile var.

Sorun şu ki, böyle bir teknoloji karşısında, şu aşamada tamamen çaresiz durumdayız. Yetişkinler de tehlike altında ama çocukları önceleyerek yaklaşırsak, bu konuda çocuğunuza ne söyleyebilirsiniz ki? Söyleyebileceğiniz tek şey, “aman çocuğum sosyal medyaya ve internete nasıl olursa olsun tek bir fotoğrafını bile yükleme” olur ki, bunun için artık çok geç.

Kaldı ki, çocuklar kendileri yüklemeseler bile ebeveynlerinin sayfalarında veya okullarının sitelerinde görüntüleri mutlaka vardır.

Zaten bu bir çözüm de değil; çocuğu ya da kendimizi çevrimiçi hayattan tamamen izole etmenin sonuçları da çok ağır olabilir. O zaman geriye sadece, yasaların bu konuda oldukça caydırıcı olarak düzenlenmesi önlemi kalıyor.

Hukuk sistemi yeterli mi?

Eşyanın tabiatı gereği, teknolojinin her zaman koşarak önden gidiyor ve hukuk arkasından emekleyerek yetişmeye çalışıyor.

İşin açıkçası, bugünkü yapay zekâ teknolojilerinin anavatanı diyeceğimiz ABD’de bile bu tip hareketleri cezalandıracak yasal zemin henüz oluşmamış durumda. Zaten cezalandırılacak olanların bir kısmının çocuk yaşta olması da başka bir çelişki yaratıyor.

MIT Technology Review’e konuşan California Üniversitesi’nden Profesör Hany Farid, şöyle demiş: “Liseli çocuklara tüm nükleer silahların anasını verdik, bu da istedikleri kişinin [tek bir görüntüsüyle] porno oluşturabilmelerini sağladı. Ve elbette bunu yapıyorlar.”

ABD’de konuyla ilgili hazırlanan yasa tasarıları, genellikle bu görüntüleri üreten ve dağıtanların sorumluluğuna odaklanmış. Ancak aynı mülakatta Profesör Farid’in de altını çizdiği gibi, sorunun bu yapay zekâ uygulamalarını sunan web siteleri, kredi kartı şirketleri ve bundan kâr sağlayan internet servis sağlayıcılarının sorumluluğu düzeyinde ele alınması gerekiyor.

Sorun sadece porno değil

Bildiğiniz gibi deepfake görüntüler sadece pornografi için üretilmiyor. Örneğin; ses kopyalama işiyle dolandırıcılık veya görüntü kopyalamayla ilgili de aklınıza gelen her şey yapılabilir.

O yüzden yapay zekâ yardımıyla oluşturulmuş tüm görüntü ve içeriğin (metin dahil) bunu açıkça belirten bir filigran, etiket eşliğinde sunulması yasal bir zorunluluk olmalı.

Bu konuda özellikle gıda sektöründeki hassas standartların örnek alınması gerektiğini düşünüyorum. Nasıl her gıda ürünü ne olduğu ve ne olmadığı açıkça belirtilen etiketle sunuluyorsa, yapay zekâ içeriğinin de üzerine geldiğinizde bir şekilde görünür olacak uyarı etiketiyle sunulması ve bunu yapmayanların ağır yasal yaptırımlara maruz kalması gerekiyor.

Zaten bu konu epeydir de teknoloji ve hukuk çevrelerinde konuşuluyor. MIT Sloan Yönetim Okulu’ndan Profesör David Rand’in de içinde olduğu bir ekip tarafından yapılan çalışma, bu uyarı etiketi cümlesinin ne olması gerektiğine odaklanmış.

Kültürel farklılıkların saklı kalması kaydıyla, “bir yapay zekâ aracıyla oluşturuldu” veya “yapay zekâ tarafından manipüle edildi” ifadelerinin, insanların en çok anlayabildiği etiket cümleleri olduğu ortaya çıkmış. Bunu, işlenmiş gıda ürünleri veya sigara üzerindeki sevimsiz uyarı etiketleri gibi düşünülebiliriz.

Görünen köy

Henüz Türkiye’de çok konuşulan bir örneğine rastlamadık ama deepfake porno konusu, önümüzdeki dönemde bizim de gündemimize girebilir.

Dilerim bu konuyu, Türkiye’den bir örnek üzerinden de konuşmak zorunda kalmayız. Sevimsiz bir durum ama görünen köy kılavuz da istemiyor.

Bu yüzden, deepfake görüntü ve içeriğin üretimi ve paylaşımı konusunda yasal standartların bir an önce belirlenmesi gerekiyor.

Bu tehlike, üzerinde bir kutuplaşma yaşanmayacak kadar herkesi ilgilendiren bir tehlike.