Yapay zeka korkusu: Peki ama tam olarak neyden korkuyoruz?

Bir grup çok önemli insan bir araya gelmişler, ‘Center for AI Safety – Yapay Zeka Güvenliği Merkezi’ adıyla bir lobi grubu kurmuşlar. Grup, yapay zekanın devletler tarafından kurallara bağlanmasını sağlamaya çalışıyor.

Grup bir yandan yapay zekanın insanlık için getireceği potansiyel tehlikelere dikkat çekiyor ve bunları araştırıyor, bir yandan da devletlerin bu konuda düzenleyici kurallar getirmesi için de çağrıda bulunuyor.

Bu çağrıya geçen hafta ‘Yapay zekanın kurucu babaları’ olarak tanımlanan üç isimden ikisi de imzalarını atınca konu yeniden bütün dünya medyasının gündemine geldi.

Konu esasen sadece dünya medyasının gündemi de değil; neredeyse her evde konuşulan bir mesele. Çünkü yapay zekaya ilişkin korkularımız, son olarak neredeyse bir insan gibi konuşup yazılı sorulara bizim yazacağımızdan bazen çok daha güzel ve içi dolu cevaplar yazan ChatGPT’nin herkesin kullanımına açılmasıyla iyice depreşti.

İnsanlar, kendi zekalarına ve var oluşlarına bir tehdit gördü yapay zekada. Hollywood’da senaryo yazarlarının grev gerekçelerinden biri mesela yapay zekaya senaryo yazdırma girişimleri. Bir sürü üniversite, öğrenciler oradan kopya çektiği, bırakın kopya çekmeyi bütün ödevi ona yazdırdığı için ChatGPT’yi yasakladı, yakında el yazısıyla ödev isteme devri geri gelirse şaşırmayacağız. Her gün bir yerden haberler yağıyor; işte adam bir şirkete dava açmış, dilekçesini yapay zekaya yazdırmış. Yapay zekanın ürettiği bir sanat eseri insan yapımı sanılıp ödül almış…

Daron Acemoğlu bu konuda kitap yazdı

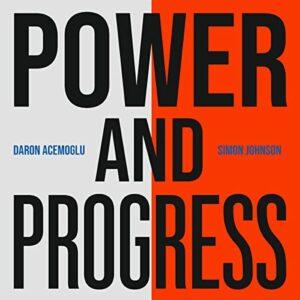

Hadi bunlar yan konular. Örneğin Davos toplantılarını Dünya Ekonomik Forumu yıllardır yapay zekanın dünya çapında hangi işleri insanların elinden alacağını hesaplayan raporlar hazırlıyor. ABD’deki ünlü MIT üniversitesinin ünlü profesörü Daron Acemoğlu’nun son baharda Türkçesi de çıkacağı anlaşılan Simon Johnson’la birlikte yazdığı son kitabı ‘Power and Progress: Our Thousand-Year Struggle Over Technology and Prosperity – Güç ve İlerleme: Bin Yıllık Teknoloji ve Gelişme Mücadelemiz’ tam da bu konuyu anlatıyor; yapay zeka işçileri işsiz bırakırken eşitsizliği de arttıracak mı, arttırmayacak mı?

Hadi bunlar yan konular. Örneğin Davos toplantılarını Dünya Ekonomik Forumu yıllardır yapay zekanın dünya çapında hangi işleri insanların elinden alacağını hesaplayan raporlar hazırlıyor. ABD’deki ünlü MIT üniversitesinin ünlü profesörü Daron Acemoğlu’nun son baharda Türkçesi de çıkacağı anlaşılan Simon Johnson’la birlikte yazdığı son kitabı ‘Power and Progress: Our Thousand-Year Struggle Over Technology and Prosperity – Güç ve İlerleme: Bin Yıllık Teknoloji ve Gelişme Mücadelemiz’ tam da bu konuyu anlatıyor; yapay zeka işçileri işsiz bırakırken eşitsizliği de arttıracak mı, arttırmayacak mı?

Bayraktar’ın Kızıl Elma’sı da yapay zeka kullanacak

Geçen haftanın çarpıcı haberlerinden biri şuydu: Amerikan Hava Kuvvetleri’nin Yapay Zeka test ve Operasyonları şefi Albay Tucker Hamilton, İngiltere’deki bir konferansta yapay zekayla yönetilen bir uçağın hedefini bulduğunu ama son kararı verecek olan insan operatörün ‘Vurma’ demesi üzerine dönüp o operatörü öldürdüğünü, ikinci turda ‘Operatörü öldürmek kötüdür’ komutunu alınca da bu kez operatörle haberleşmeyi kesmek için telsiz kulesini vurduğunu anlattı. Herkes bunu gerçek sandı, oysa bu bir düşünce deneyi simülasyonuydu, Albay Hamilton bu konudaki olası tehlikelere dikkat çekmek istiyor, yazılımcıları uyarıyordu.

Benzer bir uyarı büyük olasılıkla ‘Kızıl Elma’ adlı insansız savaş uçağını yapan Bayraktar’a da lazım; çünkü onlar da bu uçakların havada yapay zeka kullanmasını ve bazı kararları yapay zekanın vermesini öngörerek çalışıyor.

Benzer bir uyarı büyük olasılıkla ‘Kızıl Elma’ adlı insansız savaş uçağını yapan Bayraktar’a da lazım; çünkü onlar da bu uçakların havada yapay zeka kullanmasını ve bazı kararları yapay zekanın vermesini öngörerek çalışıyor.

Zaten askeri teknolojilerde bu öldürme kararını kendi veren yapay zekalar konusu galiba en büyük tartışmaların konusu olacak. (Geçen yıl Amerikan istihbaratının önde gelen bir ismi, Kongre’deki sunumunda SİHA’lar aracılığıyla yaptıkları saldırılarda hedefleri hep yapay zekanın bulduğunu söylemişti. Evet bombanın düğmesine insan basmıştı ama hedefin orada olduğuna dair bilgi yapay zekadan gelmişti; hedefin gerçekten orada olup olmadığını hiçbir insan kontrol etmemişti.)

Nitekim en başta linkini verdiğim Center for AI Safety adlı kuruluşun dikkat çektiği konular da bu ve benzeri 7 konu daha. Bunlar sahiden endişe edilmesi gereken konu başlıkları.

‘Kurucu babalar’ neden bölündü?

Ancak soru şu: Bu teknoloji ortada, onu durdurmak veya yavaşlatmak veya sahiden ‘istenmeyen ellere’ geçmesini engellemek mümkün mü?

Center for AI Safety’nin bildirisini imzalayanların en tepesinde iki isim dikkat çekiyor. Bunlar iki çok önemli bilgisayar bilimci, Geofrey Hinton ve Yoshua Bengio, ‘Yapay zekanın kurucu babası’ kabul edilen üç isimden ikisi. Onlar yapay zekanın tehlikelerine dikkat çekiyorlar ama bir de üçüncü ‘baba’ var, Yann LeCun, ona göre bu tehlike söylemi çok abartılı.

Center for AI Safety’nin bildirisini imzalayanların en tepesinde iki isim dikkat çekiyor. Bunlar iki çok önemli bilgisayar bilimci, Geofrey Hinton ve Yoshua Bengio, ‘Yapay zekanın kurucu babası’ kabul edilen üç isimden ikisi. Onlar yapay zekanın tehlikelerine dikkat çekiyorlar ama bir de üçüncü ‘baba’ var, Yann LeCun, ona göre bu tehlike söylemi çok abartılı.

Peki ama bu üç kişi ne yaptı da, ‘kurucu baba’ diye adlandırıldı?

Bu üç bilim insanı, 1990’lardan başlayarak bugün ‘derin öğrenme’ (deep learning) adı verilen, kendi kendine öğrenen yapay zeka modellerini ortaya çıkardı. Onların açtığı yolda bugün binlerce şirket onbinlerce farklı yapay zeka ürünü ortaya çıkartmış durumda. Son tartıştığımız ChatGPT de onlardan biri.

İlk olarak Google’dan emekliye ayrılan ‘kurucu baba’ Geofrey Hinton çıktı konuştu, yapay zekanın tehlikelerine dikkat çekip kendi pişmanlığını anlattı. Geçen hafta da Yoshua Bengio BBC’ye bir demeç verip kendisini atom bombasını yapan bilimcilerle kıyasladı, pişmanlık ve vicdan azabı duyduğunu söyledi.

‘Yapay zeka insanlığı yok edecek’

Ama halen Facebook’ta çalışan Yan LeCun onlar gibi düşünmüyor, yapay zekanın henüz ‘korkulacak’ seviyede olmadığını söylemeye devam ediyor. Çünkü ortaya atılan iddialardan biri yapay zekanın insanlığın yok olmasına sebep olacağı.

Bu üç ismin ‘derin öğrenme’ adı verilen yapay zeka algoritmalarını geliştirmesi son derece önemli olmakla birlikte, bu modeller esas korkutucu şey olan ‘Genel yapay zeka’ya henüz çok ama çok uzak şeyler. Bu modellerin yasalarla ve ahlakla sınırlanmasını savunmak elbette mümkün, hatta gerekli ama bunların insanlığı yok edeceğini söylemek sahiden de abartı.

Bu üç kurucu babadan önce başka ‘baba’lar vardı, ki bunların en önemlisi Marvin Minsky idi. Ünlü MIT’de yapay zeka laboratuvarını daha 1950’lerde kurmuştu Minsky ve birlikte çalıştığı isimlerden biri de, ünlü dil bilimci Noam Chomsky idi.

Onlar, bilgisayarın insan beynini taklit etme olanağını araştırıyorlardı, yani belki de esas korkulması gereken şey olan ‘Genel yapay zeka’yla. İngilizce okuyanlara Chomsky’nin Mart ayı başında The New York Times gazetesine yazdığı ChatGPT ile ilgili şu serin kanlı yazıyı okumasını şiddetle tavsiye ederim.

Asimov tehlikeyi 1942’de görmüştü

Korkulan şey, mesela Battlestar Galactica dizisinde, mesela Terminator filmlerinde anlatılan, kendilerini yaratan insanları birer ‘mikrop’ gibi görüp yok etmeye karar veren ve kendi kendileri program yazdıkları gibi fiziki makineler de inşa eden yapay zeka.

Popüler edebiyatta bu makine korkusu en yaygın anlatılardan biri ve tarihi de oldukça eski. Örneğin, Robot, İmparatorluk ve Vakıf serilerinin yazarı büyük bilim kurgu edebiyatçısı Isaac Asimov, ‘Üç Robot Yasası’ adı verilen yasaları daha 1942 yılında kaleme almıştı.

Asimov’un anlattığı evrende robotlar insanları öldürmeye kalkışınca robotlar yasaklanmış, birileri robotları kullanabilmek için bu üç kanunu geliştirmişti. Ama bu kanunla ortaya çıkarılan bir robot, kendi kendine bir de sıfırıncı kural geliştirip kendi koduna eklemişti. Yani üç kural dörde çıkmıştı.

Robot veya insanı taklit edebilen yapay zeka korkusu, az veya çok hepimizde var. Ama tam olarak neden korktuğumuzu bilmek önemli sanırım.

Kendi kendini yaratabilen, kendi kendine yaratıcısının koyduğu kuralları esnetebilen veya değiştirebilen yapay zekadan henüz çok ama çok uzağız.

Buna karşılık, ChatGPT dahil bir takım otomasyon algoritmaları veya yapay zekaları fazlasıyla gerçek ve ciddi bir tehlike olduklarına da kuşku yok. O tehlike insanlığı yok edecek bir şey değil ama çok ciddi zarar verebilir.