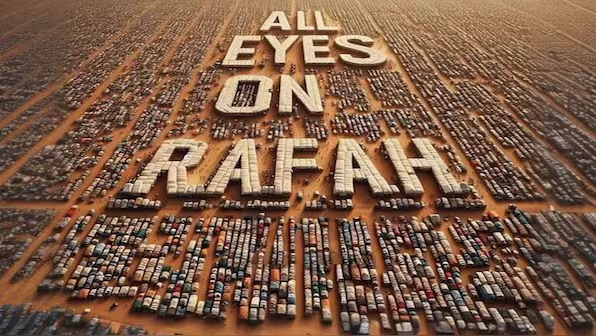

‘All Eyes on Rafah’: Yapay zekanın ürettiği görsel interneti nasıl ele geçirdi?

İsrail-Gazze savaşı sadece cephede değil, sosyal medyada da devam ediyor. Tarafların ağır bilgi kirliliğine yol açtığı sosyal mecralarda üretken yapay zekanın etkisi beklediğimiz büyüklükte mi oldu, yoksa yapay zekaya bakışımız abartı mı?

Yapay zeka tarafından üretilen fotoğrafta, İsrailli askerlere tezahürat yapan halk. Fotoğraf: Instagram

Yapay zeka tarafından üretilen fotoğrafta, İsrailli askerlere tezahürat yapan halk. Fotoğraf: Instagram Hamas’ın 7 Ekim’de İsrail’e yönelik sürpriz saldırısını başlatmasından bu yana sadece cephe hattı karışmadı, sosyal medya da epey karıştı: Daha önce bir benzeri görülmemiş dezenformasyon dalgası çıktı ortaya. “Algoritmanın yönlendirdiği bu savaş sisi” büyük organizasyonları tuzağa düşürürken, sosyal medya şirketleri de ne yapacağını bilemez hale geldi.

Bununla birlikte sosyal medyada dolaşan onca görüntü ve video arasında yapay zeka modellerine yaptırılan görüntülerin etkisi nispeten düşük kaldı. Bazıları İsrail-Gazze savaşının sahte yapay zeka görüntüleriyle bulandırılan ilk savaş olup olmayacağını merak ederken teknolojinin tahmin ettiğimizden çok daha karmaşık bir etkisi oldu.

Atlantik Konseyi’nin çevrimiçi dezenformasyon üzerine çalışan Dijital Adli Araştırma Laboratuvarı’nın yardımcı editörü Layla Mashkoor WIRED’a verdiği demeçte, “Dolaşımda olan yapay zeka görüntüleri kesinlikle vardır ama bilginin yayılmasında merkezi rol oynadığı düşünülecek bir ölçüde değil” diyor.

Mashkoor, yapay zekaya yaptırılan görüntülerin aktivistler tarafından belli bir tarafa destek istemek ya da desteğin sanıldığından çok daha büyük olduğunu düşündürtmek için kullanıldığını söylüyor. Bu örnekler arasında Tel Aviv’de İsrail ordusunu savunan, yapay zeka tarafından yapılmış bir reklam panosu, ordu için tezahürat yapan gerçek olmayan insanları ve İsrail’in Gazze bombardımanlarının kurbanlarını tasvir eden yapay zeka görüntüleri var. Mashkoor’a göre bunlar sadece destek toplamayı amaçladığından en azından şimdilik yapay zekayı kullanmanın en kötü niyetli yollarından biri değil.

Burada kilit unsurlardan biri, dolaşımda olan yanlış bilgi miktarı, bu da yapay zeka görüntülerinin şekillenmesini zorlaştırıyor. Mashkoor, “Bilgi ortamı hem gerçek hem de özgün görüntü ve videolarla dolup taşıyor zaten. Sosyal medya platformları tek başına bu görüntülerle doluyor” diyor.

Bu nokta, Harvard Kennedy School Misinformation Review’un üretken yapay zekanın dünya genelinde yanlış bilginin yayılmasında oynayabileceği rolle ilgili yakın zamanda yayınladığı bir makalede de belirtiliyor. Yazarlar makalede teknolojinin etkisi hakkındaki endişelerin “abartılı” olduğunu dile getiriyor. Yazının özeti az çok şu şekilde: “Üretken yapay zeka teoride insanların yanlış bilgileri çok hızlı bir şekilde yaymasına izin verse de bu yanlış bilgiler zaten daha çok haber kuruluşlarına güveni çok az olan, komplo teorilerini kabul etmeye oldukça yatkın kişilerce görülüyor.”

Yazarlar ayrıca dezenformasyon yaratabilecek tek aracın üretken yapay zeka olmadığının altını çiziyor. Photoshop ve video düzenleme yazılımları da pekâlâ üretken yapay zekayla aynı işlevi görebiliyor, sadece bu programlarda insanın müdahalesi çok daha fazla oluyor. Öte yandan yazarların dikkat çektiği bir gerçek daha var: Gazeteciler ve gerçeği teyit etmekle yükümlü kurumlar, deepfake’tense bağlamından koparılmış görüntülerle mücadelede çok daha fazla zorlanıyor.

Uzun lafın kısası burada asıl mesele algoritmaların nasıl yönlendirildiği. Zira UC Berkeley School of Information’da profesör olan Hany Farid, “Daha geniş bir resimden bakacak olursak, hızlı hareket eden dünyayı muhakeme yeteneğimizde bu çatışmanın geçmişte gördüklerimizden daha kötü olduğunu düşünüyorum. Bence üretken yapay zeka da bunun bir parçası ama sorumluluğu sadece yapay zekaya yükleyemeyiz. Bu olayları çok basite indirgemek olur” diyor.